面试八股FAQ

大模型技术相关问题

为什么RAG的语料库构建和query要使用同一个embedding模型?

- 一个 collection 中所有存储的向量维度必须相同,这是向量数据库的基本要求。如果使用不同的embedding模型,可能会导致语料库中的数据维度和query问题的向量维度不一致,进而无法进行相似度查询;即使两个embedding模型的输出向量维度相同,但是由于不同模型的向量空间分布和语义表达方式可能差异很大,导致相似度搜索结果不准确,影响检索的相关性和质量,降低检索效果;

- 所以必须保持一个 collection 内的向量均来自同一嵌入模型,确保语义空间一致。如果需要使用不同的嵌入模型,可以建立不同的collection,针对不同embedding模型分别存储和检索;

RAG提高检索准确率的方法有哪些?

- 补充足够的metadata信息;在langchain的document的metadata中可以补充文档的作者、标题、创建时间等其他metadata信息;在 LangChain 中将

Document对象向量化时,只有page_content(文本内容)会被用于生成向量,metadata不会被向量化。但可以将metadata信息放在提示词中,供给大模型提供更多的关键上下文信息; - 查询结果重排序;精确度提高了,但是速度变慢了;

- 知识图谱RAG

什么是混合精度训练(FP16、BF16)?

混合精度训练是一种同时使用高精度(如FP32)和低精度(如FP16、BF16)数据格式进行深度学习模型训练的方法。其主要优势在于显著提升训练速度、减少显存占用,同时保持模型的精度。FP16是16位浮点数,适合快速计算,而BF16则能表示与FP32相同的范围,更适合处理大数值变化。混合精度训练在现代深度学习框架中得到广泛应用,特别是对于大型模型如GPT和BERT等。

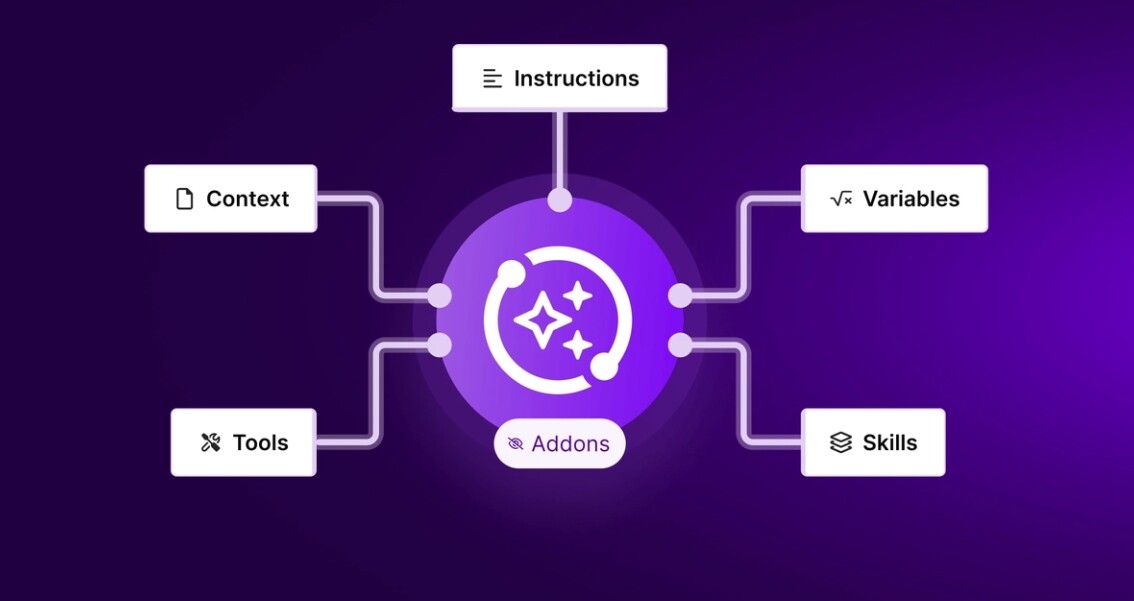

什么是LangChain?

LangChain是一个开源的大模型应用开发框架,主要帮助开发者快速搭建智能应用。它通过组件化设计,将AI的能力灵活组合到应用中。LangChain的核心组件包括Prompt模板、链(Chain)、工具(Tool)、记忆(Memory)和代理(Agent),使得开发者可以轻松构建出复杂的智能系统。其应用场景涵盖智能问答、知识库检索和多轮对话系统等。

如何确保大模型输出内容始终符合特定格式(结构化输出),不掺杂其他杂质内容?

- 使用严格提示词进行限制;但是大模型在回答时无法保证100%符合用户要求,例如要求返回

JSON格式时,可能包含“以下为JSON格式的回答”、“````json{… }`”等多余内容; - 使用

Pydantac库进行验证;可以使用Pydantic构建数据模型确保大模型模型回答符合结构化输出;

Function call 怎么训练的,怎么微调的?

工具调用能力的微调发生在 SFT 或 RLHF 阶段(可统称微调阶段)。在这过程中,关键是通过标注数据训练模型生成结构化指令。例如,可以将工具描述、参数提取示例作为输入,训练模型生成结构化调用指令。

- 大模型工具调用能力,是在预训练后加上去的,包含了多个 SFT和 DPO 的迭代过程。

- 比较有名的 function call 的数据集有 glaive-function-calling-v2-sharegpt,tools 会像 system prompt 一样,一起放到输入的 prompt 里。对话数据会和普通的多轮对话数据一样,进行多次的 SFT+DPO/RLHF 的微调。

LLM 是怎么训练出来的?

- LLM的训练流程共分为预训练-微调-对齐(微调和对齐可通常为微调步骤) 三阶段。有时还会额外添加微调流程,例如 DeepSeek 基于 DeepSeekV3 模型和强化学习微调出了 DeepSeekR1 推理模型。

- 预训练阶段 。预训练阶段通过海量文本数据学习语言模式,一般是自监督学习范式。在这个过程中,模型学习到了文本的基本范式,具备了生成人类可理解的文字的能力。

- 监督微调(SFT)。 在预训练基座上注入对话数据(如人工标注的问答对),通过指令微调范式(Instruction Tuning)使模型掌握遵循指令、生成结构化响应的能力。

- 强化学习反馈(RLHF)。 通过人类的偏好、评价或直接指导来优化智能体的行为,使其更符合人类的期望和价值观。通过该阶段,也能优化生成文本的可读性、改变思维方式。

RLHF 和 DPO ?PPO和GPRO?

Lora、QLora、全量微调的区别?

多模态模型如何训练与微调?

如何估算微调模型需要的算力与时间?

项目相关问题

RAG项目遇到的最大挑战?

- PDF图片和表格解析问题;尝试过用PyMuPDF等第三方模块对PDF文档进行解析,失败了;最终采用截图的方式将图片和表格传入多模态大模型,通过提供一定的上下文信息,让大模型来总结图片和表格,代替PDF中的图片和表格描述,并将多模态总结的文本内容嵌入知识库中,以达到替代效果;

大模型面试八卦: